📑 목차 (Table of Contents)

1. 서론: 역전파의 영광과 2025년의 균열

지난 10년간 알파고부터 ChatGPT까지, 인공지능의 폭발적인 성장을 견인한 숨은 공신은 단연 역전파(Backpropagation) 알고리즘이었습니다. 수십억 개의 파라미터를 가진 거대 모델이 정답을 찾아가도록 미분의 연쇄 법칙을 통해 길을 안내해 주었기 때문입니다.

하지만 2025년 현재, AI 학계와 산업계는 역전파의 '생물학적 타당성 부족'과 '막대한 에너지 비용'이라는 치명적인 한계에 직면했습니다. 본 포스팅에서는 딥러닝의 제왕으로 군림해 온 역전파의 기술적 깊이를 탐구하고, 이를 대체하거나 보완할 차세대 학습 패러다임(Forward-Forward, Liquid Neural Networks)을 심도 있게 분석합니다.

2. 핵심 원리: '책임 소재'를 묻는 연쇄 법칙

역전파를 한마디로 정의하면 "결과에 대한 책임을 묻는 수학적 과정"입니다. 출력층에서 발생한 오차(Loss)를 다시 입력층 쪽으로 되돌려 보내며(Backward), 각 뉴런이 오차에 얼마나 기여했는지를 미분값(Gradient)으로 계산합니다.

⛓️ 연쇄 법칙(Chain Rule)의 마법

딥러닝 모델은 수많은 함수의 합성(f(g(x)))으로 이루어져 있습니다. 역전파는 미적분학의 연쇄 법칙을 활용하여 이 복잡한 합성 함수의 미분값을 간단히 구해냅니다.

∂L/∂w = (∂L/∂y) · (∂y/∂w)

이를 통해 아무리 깊은 신경망이라도 끝에서부터 처음까지 오차 정보를 전달할 수 있습니다. 이 과정에서 AdamW나 RMSProp 같은 옵티마이저가 계산된 기울기를 바탕으로 최적의 하강 경로를 찾아냅니다.

3. 2025년 최신 동향: Forward-Forward와 힌튼의 반란

딥러닝의 아버지 제프리 힌튼(Geoffrey Hinton) 교수가 최근 "역전파는 뇌의 학습 방식이 아니다"라고 언급하며 제시한 Forward-Forward 알고리즘이 2025년 AI 트렌드의 태풍의 눈으로 떠올랐습니다.

🔍 2025년 Post-Backprop 기술 스택

- Forward-Forward 알고리즘: 오차를 역방향으로 전파하지 않고, 긍정 데이터(Positive)와 부정 데이터(Negative)를 두 번 통과시켜 층(Layer)별로 즉시 학습합니다. 메모리 사용량을 획기적으로 줄입니다.

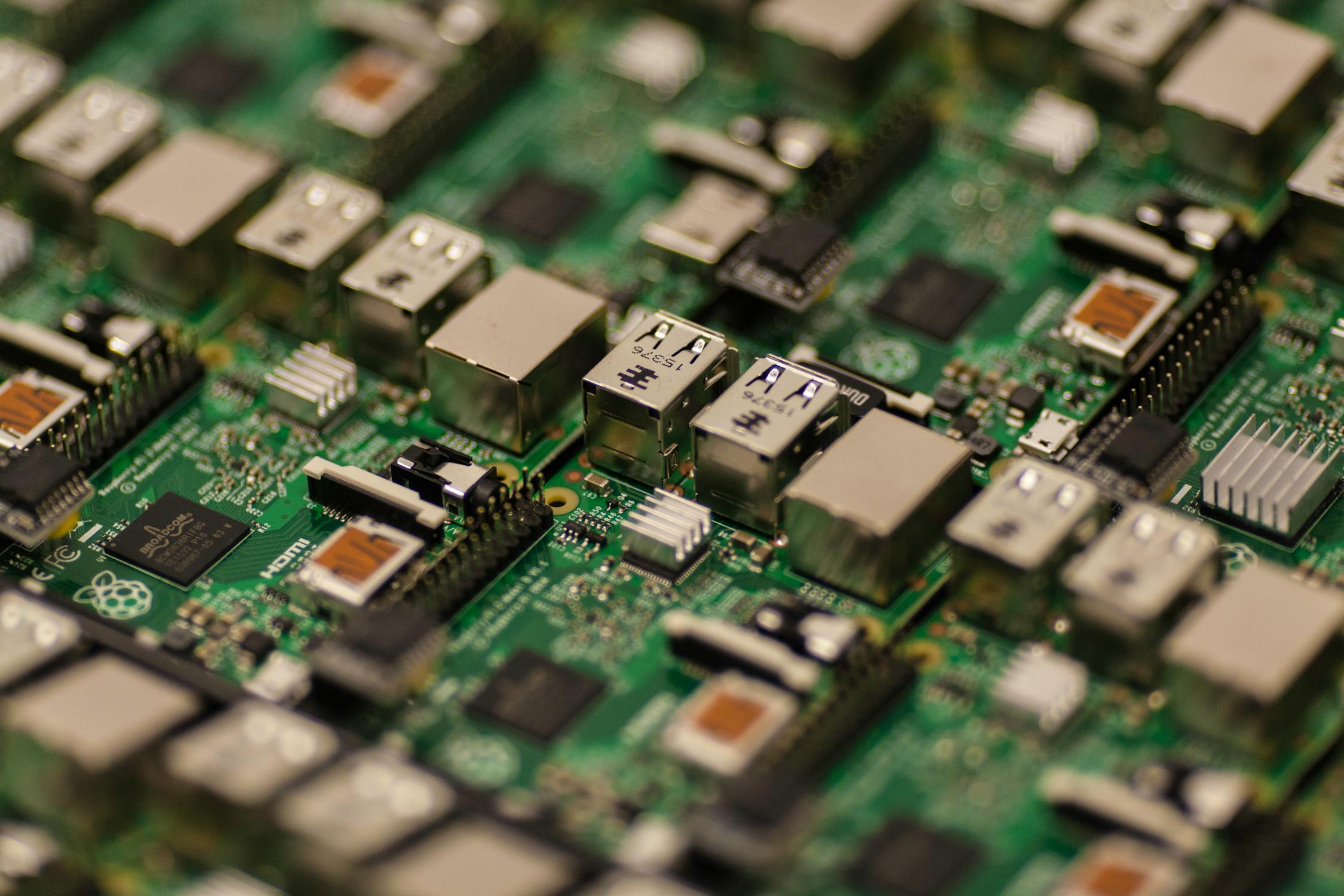

- 뉴로모픽(Neuromorphic) 컴퓨팅: 스파이킹 신경망(SNN)을 활용하여, 인간의 뇌처럼 전기가 튈 때(Spike)만 에너지를 소모하는 초저전력 온디바이스 AI의 핵심입니다.

- 액체 신경망(Liquid Neural Networks): 학습이 끝난 후에도 환경에 적응하여 시냅스 구조를 유동적으로 바꾸는, 시계열 데이터 처리에 특화된 차세대 모델입니다.

4. 실무 가이드: 기울기 소실과 메모리 효율화

아직 대다수의 프레임워크(PyTorch, TensorFlow)는 역전파를 표준으로 사용합니다. 실무에서 역전파를 다룰 때 엔지니어들이 가장 많이 겪는 문제와 해결책을 정리했습니다.

📉 1. 기울기 소실과 폭발 (Vanishing & Exploding Gradient)

네트워크가 깊어질수록 역전파되는 오차값이 0에 수렴하거나 무한대로 발산하는 문제입니다.

✅ 솔루션: ReLU 계열 활성화 함수 사용, Batch Normalization 적용, 그리고 오차값의 상한선을 자르는 Gradient Clipping이 필수적입니다.

💾 2. 메모리 효율화 (Gradient Checkpointing)

역전파를 위해서는 순전파 때 계산된 모든 중간값을 메모리에 들고 있어야 합니다. 이는 VRAM 부족(OOM)의 주원인입니다.

✅ 솔루션: Gradient Checkpointing 기술을 사용하면, 중간값의 일부만 저장하고 나머지는 역전파 시에 다시 계산하여 메모리 사용량을 1/5 수준으로 줄일 수 있습니다.

5. 전문가 인사이트: 하이브리드 학습의 시대

6. 결론

역전파는 우리가 현재 누리고 있는 AI 혁명의 기반을 닦았습니다. 하지만 2025년은 효율성과 생물학적 모방이라는 새로운 키워드가 시장을 지배하기 시작했습니다. 엔지니어로서 역전파의 수학적 원리를 완벽히 이해하는 것은 여전히 중요합니다. 그러나 동시에 '미분 없는 학습(Gradient-free Learning)'이라는 새로운 흐름에 관심을 가져야 할 때입니다. 기술의 수명 주기는 짧고, 변화를 미리 읽는 자만이 살아남습니다.